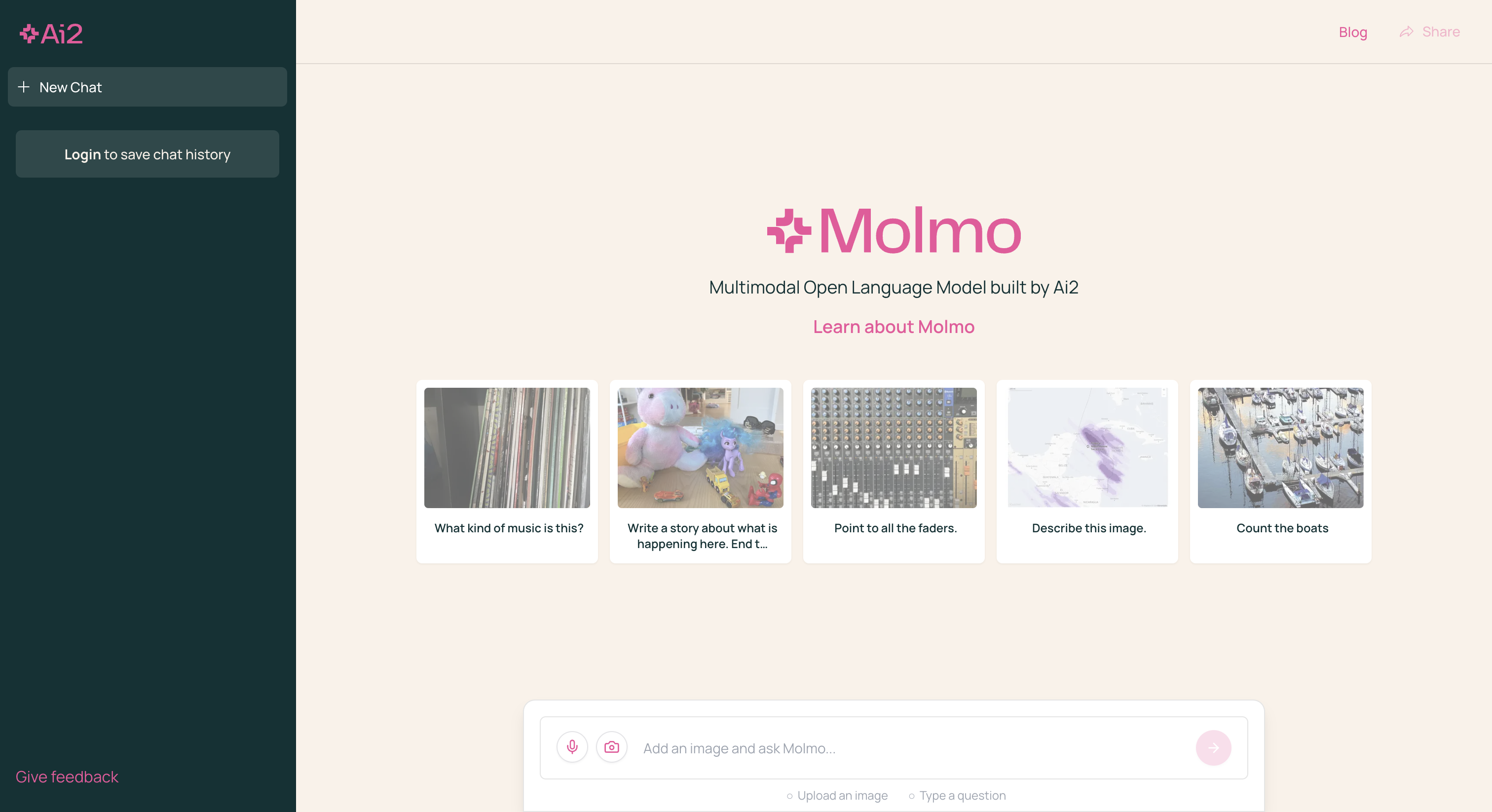

MolmoAI by Ai2 介绍

Molmo是一个最新的开源多模态AI模型家族。它打破了现有开放和封闭系统之间的界限,在多个学术基准和人类评估中表现出色。Molmo不仅能理解多模态数据并用自然语言表达,还通过“指示”技术,实现与物理和虚拟世界的丰富互动,推动了应用的下一代发展。而且,这些模型利用高质量的数据来减少对巨大数据量的依赖,如同用精炼的语言来阐明复杂的想法,使其在小数据集上训练依旧强大。在视觉模型的开放性和性能方面,Molmo展现了极大的潜力,尤其在不依赖专有系统的情况下,提供了更多创新应用的可能。

MolmoAI by Ai2 主要功能

强大的多模态交互

Molmo不仅能理解多模态数据,还能通过指点功能进行优雅的人机互动,让AI与虚拟和物理世界无缝对接,激发应用新潜力。

开放性与透明性

以开放的权重和数据为基础,Molmo从零构建高效模型,无需依赖私有VLM,这如同为研究界打开了一扇清晰之窗。

精细数据集加持

借助通过语音描述收集的高质量图像标注数据,Molmo训练高效,不依赖海量数据质优胜过量大。

灵活的场景应用

支持广泛的用户交互,从问题解答到指点物体,无论是读图还是分析文本都游刃有余,像是为AI插上了智慧的翅膀。

人性化的结果评估

通过大规模的人类偏好评价系统,Molmo既经得起学术考验,也能在用户体验中脱颖而出,为性能提供双重保障。

MolmoAI by Ai2 使用案例

机器人路径规划:Molmo运用其指点功能帮助机器人识别并指向特定对象,实现精准的路径规划和物体拾取,提升自动化作业效率。

虚拟教育助手:Molmo通过多模态互动功能,为学生提供图文并茂的教育内容,增强学习体验,提高知识吸收率。

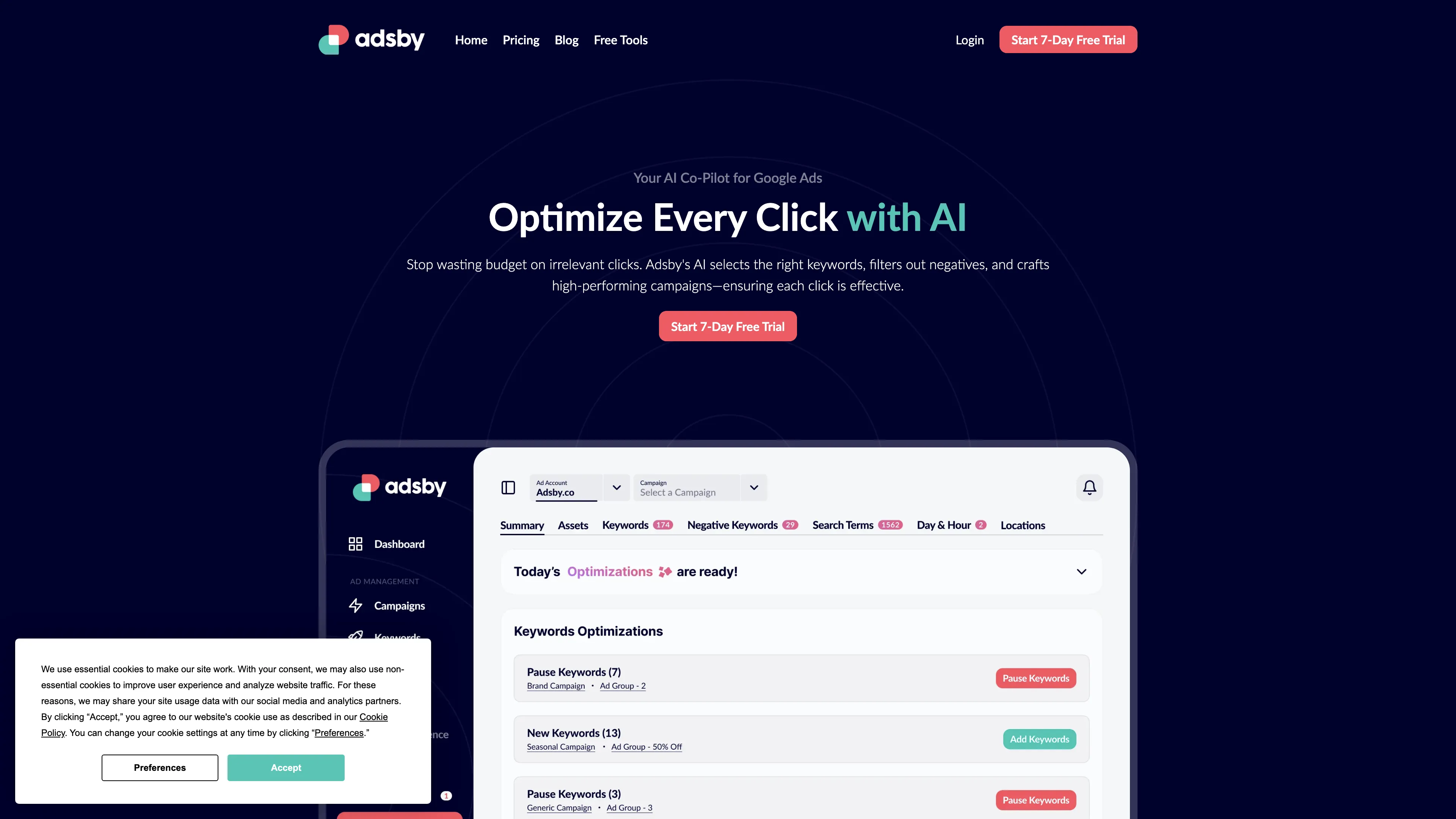

UI自动化测试:Molmo利用2D指点数据,识别并点击网页界面元素,优化软件自动化测试流程,降低人工参与成本。

医疗影像分析:Molmo结合细致图像解读功能,对复杂医疗图像进行分析,辅助医生制定更精准的诊断方案。

游戏开发创新:游戏开发者利用Molmo的丰富交互能力,创建更具沉浸感的虚拟世界,提升玩家的互动体验。

MolmoAI by Ai2 用户指南

Step 1: 访问Molmo网站并注册一个新账号以获取访问权限。

Step 2: 进入Molmo的在线演示页面,选择您感兴趣的多模态任务。

Step 3: 上传或输入图像和文本数据,Molmo将自动生成相应的描述和解答。

Step 4: 利用Molmo的指点功能,直接在图像上标注或指定目标位置。

Step 5: 使用生成的结果和模型输出,探索不同的应用场景和交互方式。

MolmoAI by Ai2 常见问题

MolmoAI by Ai2 网站分析

- United States27.8%

- China6.8%

- India6.6%

- Vietnam5.8%

- United Kingdom4.3%

MolmoAI by Ai2 替代品

AI Sentence Generator利用最新的AI模型和NLP技术,为创作者、市场营销人员提供快速高效的语句生成服务,大大提升生产力和准确性。